En el ecosistema actual, desplegar un agente de IA sin un marco de MLSecOps es el equivalente digital a dejar las llaves de una caja fuerte pegadas a la puerta con un post-it. Ya no basta con proteger el perímetro; ahora debemos proteger el razonamiento y el flujo de datos de la propia inteligencia.

A continuación, presentamos un análisis técnico sobre la evolución del escaneo de vulnerabilidades aplicado a sistemas de IA y por qué la continuidad no es una opción, sino un requisito de supervivencia.

El Cambio de Paradigma: De Código Estático a Pesos Dinámicos

El escaneo tradicional (SAST/DAST) busca desbordamientos de búfer o inyecciones SQL. Sin embargo, en un sistema de IA, la «vulnerabilidad» puede residir en la arquitectura del modelo o en la manipulación del contexto.

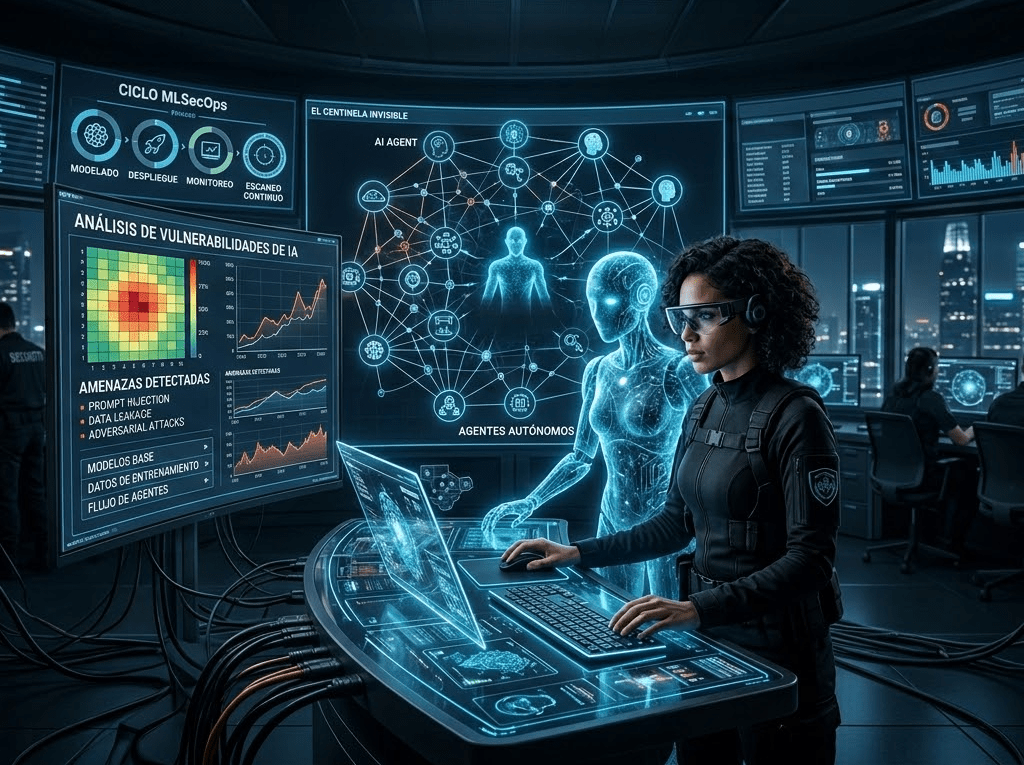

MLSecOps integra la seguridad en el ciclo de vida del Machine Learning, transformando el escaneo en un proceso tridimensional:

- Escaneo de Suministro (Supply Chain): Verificación de procedencia de modelos base (Hugging Face, GitHub) y detección de malware embebido en archivos .pickle o .safetensors.

- Análisis de Robustez Adversaria: Pruebas automatizadas para detectar la susceptibilidad a Prompt Injection (Directa e Indirecta) y ataques de evasión.

- Auditoría de Salida (Data Leakage): Filtros activos que escanean si el agente está revelando PII (Información de Identificación Personal) o secretos del sistema en sus respuestas.

Tutorial Técnico: Implementando un Escaneo de Vulnerabilidades con Enfoque MLSecOps

Para asegurar un sistema de IA o un agente autónomo, el flujo de escaneo debe estar orquestado de la siguiente manera:

Paso A: Escaneo de Vulnerabilidades en Dependencias (Software Composition Analysis)

Antes de tocar el modelo, debemos asegurar el entorno. Utiliza herramientas como Trivy o Snyk para escanear las imágenes de contenedor y las librerías de Python (como LangChain o PyTorch).

Bash

trivy image –severity HIGH,CRITICAL my-ai-agent-app:latest

Paso B: Evaluación de Riesgos en LLMs (Red Teaming Automatizado)

Implementa un escaneo específico para modelos utilizando frameworks como Giskard o PyRIT (Python Risk Identification Tool).

- Generación de Probes: El sistema crea miles de variaciones de prompts maliciosos.

- Inyección de Prueba: Se ejecutan ataques de «jailbreak» para intentar que el agente ignore sus instrucciones de seguridad.

- Clasificación de Fallos: Se miden las tasas de éxito de la inyección.

Paso C: Integración en el Pipeline (CI/CD/ML)

El escaneo no debe ser un evento aislado. Debe vivir en tu pipeline de automatización (por ejemplo, en n8n o GitHub Actions), disparando alertas si el modelo muestra una degradación en su seguridad tras un re-entrenamiento o ajuste de hiperparámetros.

La Importancia Crítica del Escaneo Continuo

¿Por qué hacerlo cada hora y no cada mes? Por tres razones fundamentales:

- Deriva del Modelo (Model Drift): A medida que los agentes interactúan con datos del mundo real, su comportamiento puede cambiar. Un agente que era seguro ayer puede volverse vulnerable hoy debido a una actualización en su base de conocimientos vectorial (RAG).

- Vulnerabilidades de Día Cero en IA: El campo de la seguridad en IA evoluciona a una velocidad frenética. Nuevas técnicas de inyección indirecta aparecen semanalmente; el escaneo continuo permite aplicar parches de seguridad (guardrails) en tiempo real.

- Cumplimiento Dinámico: Con normativas como la Ley de IA de la UE o los estándares de OWASP para LLMs, la trazabilidad de los escaneos es el único respaldo legal ante una brecha de seguridad.

En la intersección de la ciberseguridad y la IA, el escaneo de vulnerabilidades bajo MLSecOps es nuestra mejor defensa contra lo impredecible. No se trata solo de encontrar errores, sino de construir resiliencia algorítmica