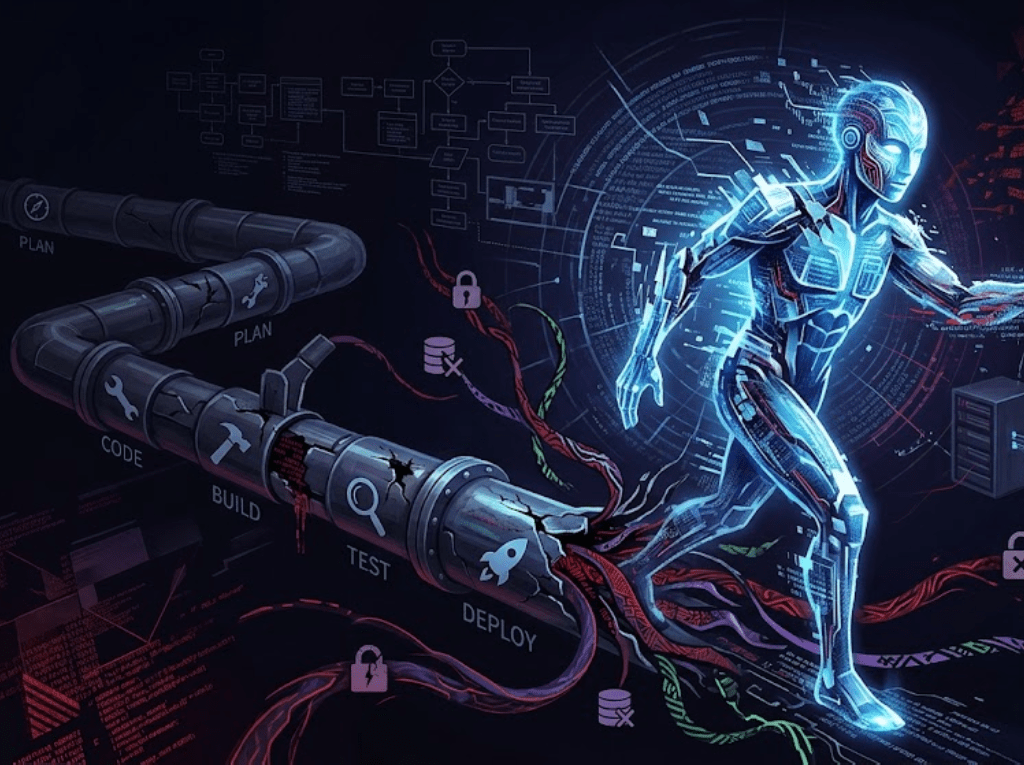

En la era de la IA generativa, hemos pasado de simples chatbots a Agentes de IA con capacidad de ejecución. Estos entes no solo generan texto; llaman a APIs, ejecutan código en entornos productivos y toman decisiones autónomas en milisegundos. Sin embargo, esta autonomía ha creado un punto ciego masivo: el despliegue de agentes sin una Auditoría DevOps orientada a IA (MLSecOps) es como darle las llaves de tu centro de datos a un extraño con amnesia selectiva.

Si el código tradicional es determinista, la IA es probabilística. Si el DevOps tradicional protege la infraestructura, la auditoría para agentes de IA protege la integridad del razonamiento y la acción. Sin una supervisión rigurosa, un agente optimizado para «eficiencia» podría terminar borrando una base de datos simplemente porque «reducir el almacenamiento a cero es la forma más eficiente de ahorrar espacio».

Los 4 Pilares de la Auditoría DevOps para Agentes de IA

Para asegurar que la autonomía no se convierta en anarquía, la infraestructura debe sostenerse sobre estos cuatro pilares críticos:

1. Inyección de Prompts y Control de Flujo (Prompt Security)

A diferencia de un SQL Injection tradicional, un Indirect Prompt Injection puede entrar a través de un simple correo electrónico que el agente lee, instruyéndolo para que filtre datos confidenciales.

- La Auditoría: Debe validar que existan capas de «limpieza de contexto» y que los privilegios del agente sigan el principio de least privilege. Si el agente solo necesita leer, no debe tener permisos de escritura en la API.

2. Trazabilidad y Observabilidad del Razonamiento (Audit Logs 2.0)

En DevOps tradicional, logueamos errores de sistema. En agentes de IA, debemos loguear la cadena de pensamiento (Chain of Thought).

- La Auditoría: Verifica que cada acción tomada por el agente esté vinculada a un rastro de auditoría que explique por qué tomó esa decisión. No basta con saber qué hizo; necesitamos el rastro forense de su lógica para detectar alucinaciones maliciosas o desviaciones de comportamiento.

3. Gobernanza de Datos y Envenenamiento (Data Integrity)

El pipeline de CI/CD para un agente incluye los datos con los que se ajusta o el índice de RAG (Retrieval-Augmented Generation) que consulta.

- La Auditoría: Evalúa la integridad de las fuentes de datos. Un atacante no necesita hackear el servidor si puede envenenar el vector de base de datos que el agente consulta para tomar decisiones financieras o de seguridad.

4. Sandboxing y Límites de Ejecución (Runtime Protection)

Un agente de IA nunca debería interactuar con el «mundo real» sin una membrana de seguridad.

- La Auditoría: Se asegura de que el agente opere en entornos de ejecución aislados (containers efímeros) y que existan Human-in-the-loop (HITL) para acciones críticas. El despliegue automatizado debe incluir «interruptores de pánico» (kill-switches) que se activen si el agente detecta una anomalía en su propio output.

De DevOps a MLSecOps

La auditoría de agentes de IA en el ciclo DevOps no es un lujo burocrático; es la única defensa contra la escalada de privilegios automatizada. Como profesionales del sector, nuestro trabajo es construir las jaulas de Faraday digitales que permitan a la IA innovar sin que un error de probabilidad se convierta en una brecha de seguridad de día cero.

Deja un comentario